Veröffentlicht:

Die 5 verschiedenen Stufen von KI-Agenten

KI-Agenten werden als künstliche Entitäten definiert, die ihre Umgebung wahrnehmen, Entscheidungen treffen und auf der Grundlage der verfügbaren Werkzeuge Maßnahmen ergreifen können.

Überlegungen zur Domäne

Es gab viel Aufregung, Alarmismus und Spekulation über AGI oder Künstliche Superintelligenz (ASI) und was die Organisationen vorbereiten. Aber das Interessanteste ist, wie man die Macht der LLM und der autonomen IA-Agenten für spezifische Implementierungen in den Organisationen nutzen kann.

Der große Wirtschaftsmotor der konversationalen Benutzeroberflächen sind Banken, Einzelhandel, Finanzdienstleistungen usw., die KI-basierte Benutzeroberflächen erstellen, damit die Benutzer mit Produkten und Dienstleistungen interagieren.

Jede Entität, die in der Lage ist, ihre Umgebung wahrzunehmen und Handlungen auszuführen, kann als Agent betrachtet werden.

Wo befinden wir uns derzeit?

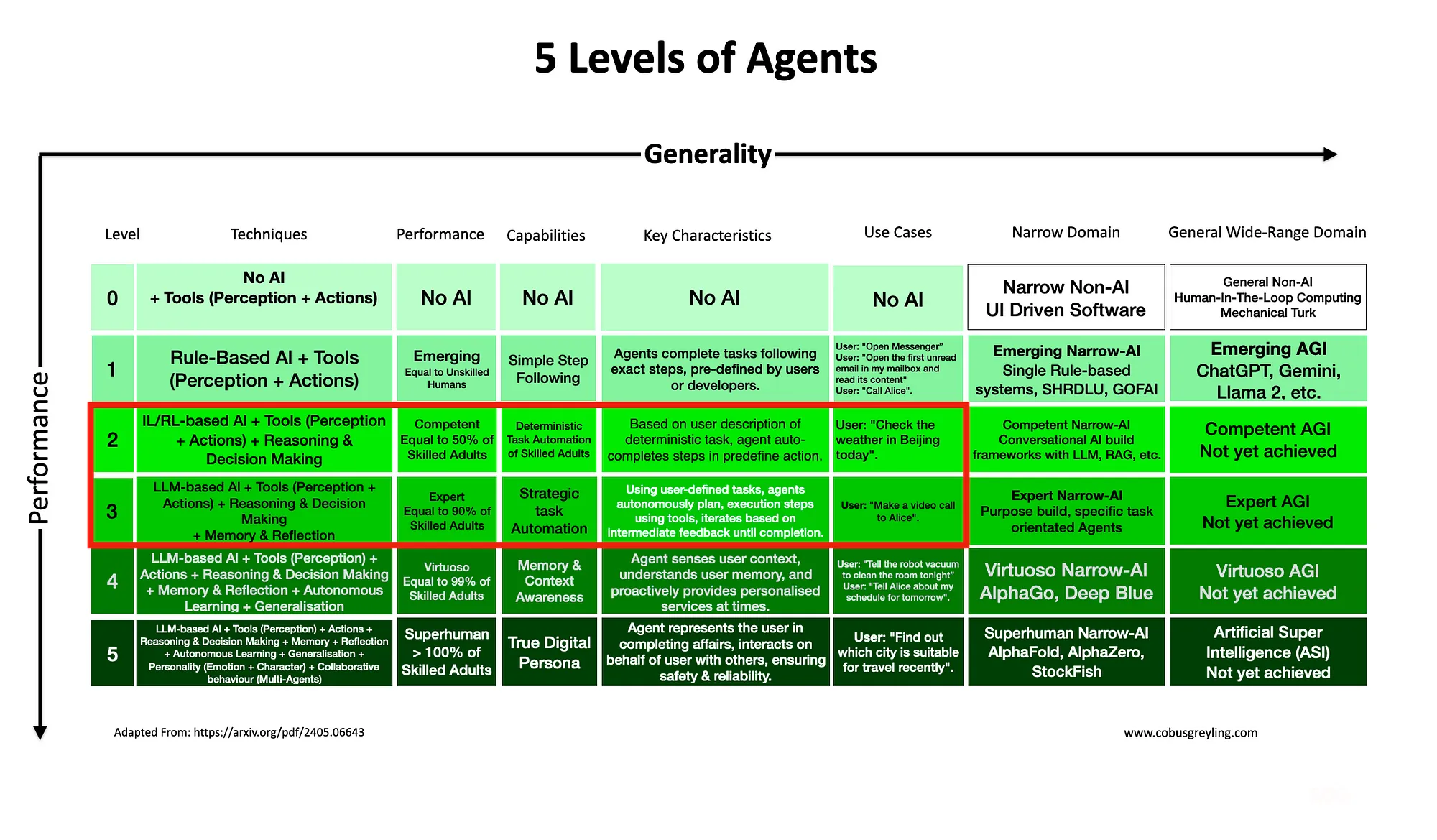

Unter Berücksichtigung von Implementierungen mit begrenztem Umfang befinden wir uns derzeit auf den Ebenen zwei und drei; sehr wahrscheinlich auf der Ebene 2.5.

LangChain hat die Schaffung von Rahmenwerken für die Entwicklung von Agenten angeführt. DSPy in der Programmierung von LLM und LLamaIndex mit seinem agenziellem RAG-Ansatz.

Diese Agenten befinden sich zwischen 50% und 90% der qualifizierten Erwachsenen, mit Fähigkeiten zur Automatisierung strategischer Aufgaben. Basierend auf Eingaben des Benutzers können die Agenten die Beschreibung des Benutzers aufschlüsseln, Unteraufgaben planen und diese Aufgaben geordnet ausführen, um zu einer Schlussfolgerung zu gelangen.

Diese Agenten sind in der Lage, über Zwischenaufgaben zu iterieren, bis sie zu einer schlüssigen Antwort gelangen.

Praktisches Beispiel

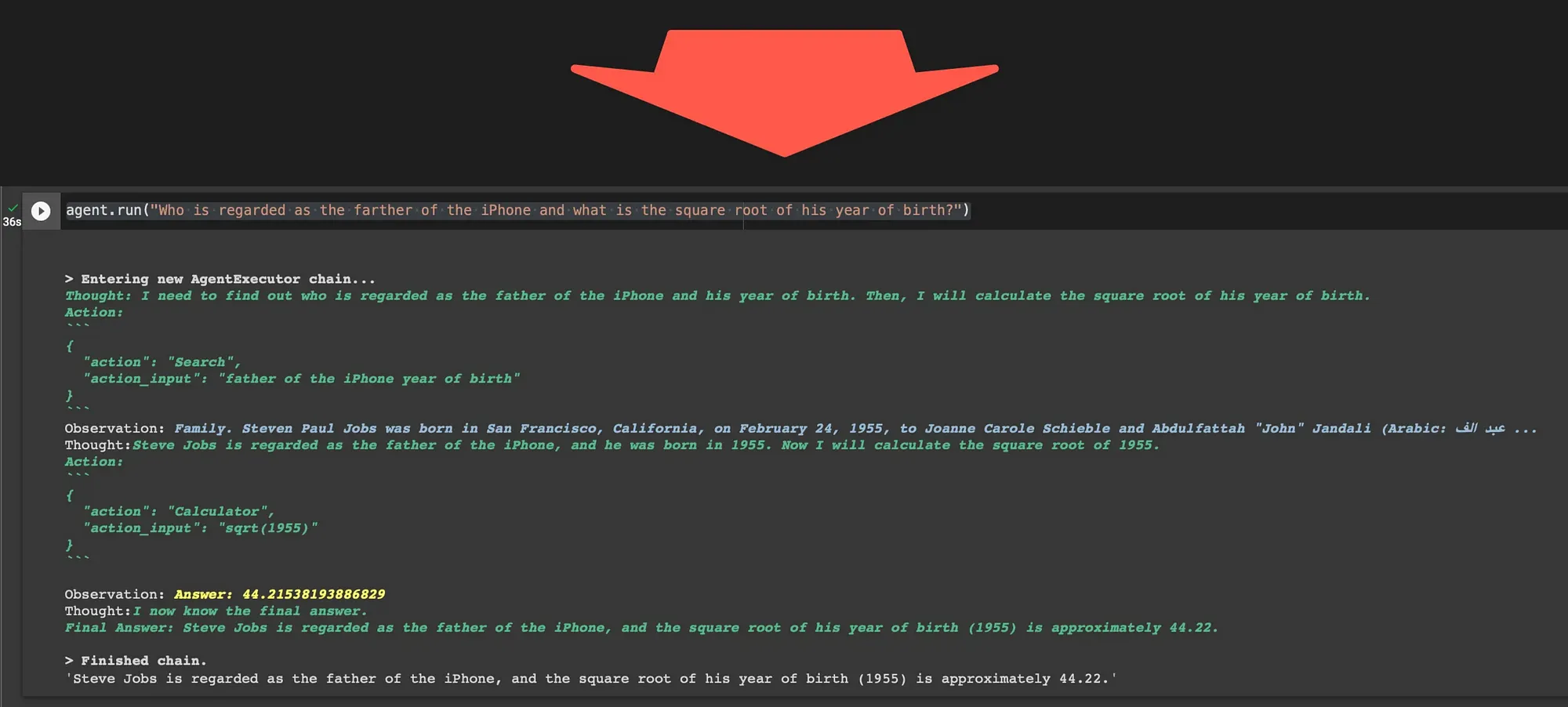

Betrachten wir die folgende Frage: Wer wird als der Vater des iPhone angesehen und was ist die Quadratwurzel seines Geburtsjahres?

Es handelt sich um eine ziemlich mehrdeutige und komplexe Frage, die eine Reihe von Schritten erfordert, um zu einer Antwort zu gelangen. Es gibt eine mathematische Aufgabe und das Ziel, aber es müssen auch Kenntnisse abgerufen werden, um die Frage zu beantworten.

Für dieses praktische Beispiel hat der Agent einige Aktionen zur Verfügung:

LLM Math,

SerpApi, unten sehen Sie einen Screenshot der SerpApi-Website. SerpApi ermöglicht es, Daten aus den Ergebnissen von Suchmaschinen zu extrahieren.

GPT-4 (gpt-4-0314).

Betrachten Sie nun die Ausgabe dieses auf LangChain basierenden Agents und beobachten Sie, wie der Agent von Denken über Handeln zu Beobachtung in einer sequenziellen Weise übergeht, bis er zu einer endgültigen Antwort gelangt und die Kette endet.

In der Tabelle, die die fünf Ebenen von Agents zeigt, werden Sie feststellen, dass die Agents der ersten Ebene regelbasiert sind… Regelbasierte Agents können eine gewisse Autonomie haben, bestehen jedoch in der Praxis aus vordefinierten Schritten, die basierend auf vordefinierten Schritten ausgeführt werden.

Grundstruktur der engen Domänenagenten

Die Agenten haben als Rückgrat ein großes Sprachmodell (LLM). Die Agenten haben auch Zugriff auf eine Reihe von Werkzeugen. Die Werkzeuge können spezifische Fähigkeiten haben, wie Websuche, spezifische APIs, RAG, Mathematik und mehr.

Die Werkzeuge werden in natürlicher Sprache beschrieben, sodass der Agent weiß, welches Werkzeug er in einer bestimmten Phase des Prozesses verwenden soll. Die Anzahl der Werkzeuge und die Fähigkeiten der Werkzeuge bestimmen, wie leistungsfähig der Agent ist.

Praktische Überlegungen

Wenn wir die Implementierungen von Agenten in begrenzten Domänen erneut betrachten, gibt es einige praktische Überlegungen zu beachten.

Sensorisch

Die meisten aktuellen Agenten sind virtuell und werden über Sprache oder Text angesprochen. Diese Agenten können schlussfolgern und zu Ergebnissen kommen und wiederum mit Sprache oder Text antworten. Es können multimodale Elemente hinzugefügt werden, bei denen Agenten Bilder oder Videos als Eingaben erhalten oder Bilder oder Videos als Ausgaben erzeugen können.

Im Allgemeinen verfügen Agenten jedoch nicht über andere sensorische Fähigkeiten wie Sehen, Tasten, Bewegung usw. Angesichts der gesamten Entwicklung im Bereich der Robotik wird die Kombination von Agenten mit sensorischen/f physischen Fähigkeiten den Beginn einer neuen Ära markieren.

LLM Backbone

Wie ich bereits erwähnt habe, ist der Agent auf einem LLM angewiesen, oder genauer gesagt auf einer LLM-API, die aufgerufen wird. Agenten durchlaufen mehrere Iterationen und API-Aufrufe. Es gibt eine einzige Abhängigkeit, die berücksichtigt werden muss, weshalb ich sagen würde, dass in jeder Produktionsimplementierung von Agenten die Redundanz in das Rückgrat des Agenten integriert werden muss.

Selbst gehostete LLM oder lokale Inferenzserver sind die beste Möglichkeit, um eine hohe Verfügbarkeit zu gewährleisten.

Kosten

Die Nutzung kommerzieller LLM-APIs wird sehr teuer sein, da das LLM bei jeder Frage, die dem Agenten gestellt wird, mehrfach konsultiert wird.

Sich Tausende von Benutzern vorzustellen, wird das Kostenproblem nur verschärfen.

Latenz

Konversationssysteme erfordern Antworten in Subsekunden, jedes komplexe System, wie Agenten, die mehrere Schritte intern für jeden Dialogturnus ausführen müssen, erhöht die gesamte Latenz, die der Benutzer erlebt.

Das kann zu einer Herausforderung werden.

Es nicht zu einer Schlussfolgerung bringen

Es ist wichtig zu beachten, dass es derzeit Fälle gibt, in denen der Agent keine Schlussfolgerung zieht oder voreilig eine Schlussfolgerung zieht. Wenn der Benutzer auf die Schritte des Agenten zugreifen und diese einsehen kann, könnte die Benutzeranfrage durch Zwischenschritte in der Argumentation des Agenten befriedigt werden. In diesem Fall könnte der Benutzer den Agenten anhalten und ihm mitteilen, dass genug Informationen bereitgestellt wurden.

Werkzeuge und Kosten

Agenten müssen Zugriff auf Werkzeuge haben, um ihre Aufgaben zu erfüllen. Es könnte einen ganzen Markt geben, in dem Werkzeuge gemeinschaftlich erstellt werden. Wo die Ersteller keine Werkzeuge von Grund auf neu erstellen müssen, sondern ein bestehendes Werkzeug auswählen können.

Diese Werkzeuge können kostenlos oder kostenpflichtig sein; die Werkzeuge können auf kostenpflichtige APIs zugreifen.

Der Begriff Agenten

Mit den Fortschritten der KI wird der Begriff Agent verwendet, um Entitäten zu beschreiben, die ein intelligentes Verhalten zeigen und über Fähigkeiten wie verfügen:

Autonomie,

Reaktivität,

Proaktivität und

soziale Interaktionen.

In den 1950er Jahren führte Alan Turing den ikonischen Turing-Test ein, ein grundlegendes Konzept in der KI, das dazu dient herauszufinden, ob Maschinen ein Verhalten zeigen können, das dem von Menschen ähnelt. Diese KI-Entitäten werden oft als Agenten bezeichnet und bilden die grundlegenden Bestandteile der Ressourcen.

Transferlernen

Transferlernen besteht darin, das Wissen, das in einer Aufgabe erworben wurde, auf eine andere anzuwenden.

Basismodellierungen folgen oft diesem Ansatz, bei dem ein Modell zunächst in einer verwandten Aufgabe trainiert und anschließend für die spezifische nachfolgende Aufgabe verfeinert wird.

Transferlernen ist ein kraftvolles Konzept und erhöht die Vielseitigkeit der Modelle, die Aufgaben ausführen können, die sie zuvor noch nie gesehen haben, basierend auf vorherigem Lernen.

Fazit

Irgendwie wird übersehen, dass die autonomen KI-Agenten einen grundlegenden Fortschritt in der Technologie darstellen.

Die Agenten, ausgestattet mit künstlicher Intelligenz, haben die Fähigkeit zu:

Unabhängig zu operieren,

Entscheidungen zu treffen und

Ohne ständige menschliche Intervention zu handeln.

In der Zukunft werden autonome KI-Agenten dazu beitragen, Branchen zu revolutionieren, die von Gesundheitswesen und Finanzen bis hin zu Fertigung und Transport reichen.

Es gibt jedoch Überlegungen zur Verantwortlichkeit, Transparenz, Ethik, Verantwortung und Voreingenommenheit bei der Entscheidungsfindung.

Trotz dieser Herausforderungen ist die Zukunft der autonomen KI-Agenten sehr vielversprechend. Während sich die Technologie weiterentwickelt, werden diese Agenten zunehmend in unser tägliches Leben integriert.